Esto es lo que es ilegal según las 9 (y contando) nuevas leyes de inteligencia artificial de California

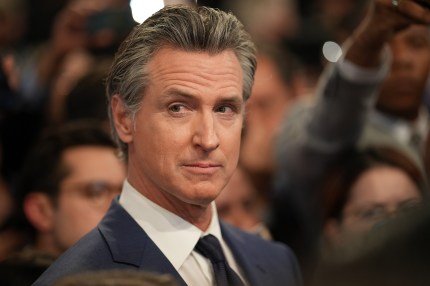

El gobernador de California, Gavin Newsom, actualmente está considerando 38 proyectos de ley relacionados con la inteligencia artificial, incluido el muy controvertido SB 1047, que la legislatura del estado envió a su escritorio para su aprobación final. Estas leyes tratan de abordar los problemas más urgentes en inteligencia artificial: desde sistemas de IA futuristas que crean riesgos existenciales, deepfake de desnudos creados por generadores de imágenes de IA, hasta estudios de Hollywood creando clones de IA de artistas fallecidos.

"Siendo el hogar de la mayoría de las principales compañías de IA del mundo, California está trabajando para aprovechar estas tecnologías transformadoras para ayudar a abordar desafíos urgentes mientras estudia los riesgos que presentan", dijo la oficina del gobernador Newsom en un comunicado de prensa.

Hasta ahora, el gobernador Newsom ha firmado nueve de ellas en ley, algunas de las leyes de IA más amplias de Estados Unidos hasta la fecha.

Llamadas automáticas de IA

El viernes, el gobernador Newsom firmó un proyecto de ley que requiere que las llamadas automáticas revelen si han utilizado voces generadas por IA. El AB 2905 tiene como objetivo prevenir otra instancia de la llamada automática deepfake que se asemeja a la voz de Joe Biden que confundió a muchos votantes de New Hampshire a principios de este año.

Deepfake de desnudos

Newsom firmó dos leyes que abordan la creación y difusión de deepfake de desnudos el jueves. El SB 926 criminaliza el acto, haciéndolo ilegal chantajear a alguien con imágenes de desnudos generadas por IA que se asemejan a ellos.

El SB 981, que también se convirtió en ley el jueves, requiere que las plataformas de redes sociales establezcan canales para que los usuarios informen deepfake de desnudos que se asemejan a ellos. El contenido debe ser bloqueado temporalmente mientras la plataforma lo investiga, y eliminado permanentemente si se confirma.

Marcas de agua

También el jueves, Newsom firmó un proyecto de ley para ayudar al público a identificar contenido generado por IA. El SB 942 requiere que los sistemas de IA generativa ampliamente utilizados revelen que son generados por IA en los datos de procedencia de su contenido. Por ejemplo, todas las imágenes creadas por Dall-E de OpenAI ahora necesitan una pequeña etiqueta en sus metadatos que diga que son generadas por IA.

Muchas compañías de IA ya hacen esto, y hay varias herramientas gratuitas que pueden ayudar a las personas a leer estos datos de procedencia y detectar contenido generado por IA.

Deepfakes de elecciones

A principios de esta semana, el gobernador de California firmó tres leyes que reprimen los deepfakes de IA que podrían influir en las elecciones.

Una de las nuevas leyes de California, AB 2655, requiere que las grandes plataformas en línea, como Facebook y X, eliminen o etiqueten los deepfakes de IA relacionados con elecciones, así como crear canales para informar dicho contenido. Los candidatos y funcionarios electos pueden buscar alivio cautelar si una gran plataforma en línea no está cumpliendo con el acto.

Otra ley, AB 2839, apunta a los usuarios de redes sociales que publican o comparten nuevamente deepfakes de IA que podrían engañar a los votantes sobre las próximas elecciones. La ley entró en vigor inmediatamente el martes, y Newsom sugirió que Elon Musk podría estar en riesgo de violarla.

Los anuncios políticos generados por IA ahora requieren revelaciones directas según la nueva ley de California, AB 2355. Eso significa que en el futuro, Trump puede que no pueda salirse con la suya publicando deepfakes de IA de Taylor Swift respaldándolo en Truth Social (ella respaldó a Kamala Harris). La FCC ha propuesto un requisito similar de divulgación a nivel nacional y ya ha hecho ilegales las llamadas automáticas que utilizan voces generadas por IA.

Actores y IA

Dos leyes que Newsom firmó el martes, las cuales SAG-AFTRA, el sindicato de actores de cine y televisión más grande de la nación, estaba promoviendo, establecen nuevos estándares para la industria de medios de California. El AB 2602 requiere que los estudios obtengan el permiso de un actor antes de crear una réplica generada por IA de su voz o imagen.

Mientras tanto, el AB 1836 prohíbe a los estudios crear réplicas digitales de artistas fallecidos sin el consentimiento de sus herederos (por ejemplo, réplicas legalmente autorizadas se utilizaron en las recientes películas de "Alien" y "Star Wars", así como en otras películas).

¿Qué queda?

El gobernador Newsom aún tiene que decidir sobre 29 proyectos de ley relacionados con la IA antes de finales de septiembre. Durante una charla con el CEO de Salesforce, Marc Benioff, el martes durante la conferencia de Dreamforce 2024, Newsom pudo haber insinuado su postura sobre SB 1047 y cómo está pensando en regular la industria de la IA de manera más amplia.

"Hay un proyecto de ley que es destacado en términos de discurso y conciencia pública; es este SB 1047", dijo Newsom el martes. "¿Cuáles son los riesgos demostrables en la IA y cuáles son los riesgos hipotéticos? No puedo resolverlo todo. ¿Qué podemos resolver? Y esa es la aproximación que estamos tomando en todo el espectro de esto".

Vuelve a consultar este artículo para obtener actualizaciones sobre qué leyes de IA firma el gobernador de California y cuáles no.